21

Sep 2020

Twitter tiene problemas con el color de piel

La fría pero confiable lógica de las computadoras a menudo ha sido enfrentada a la subjetividad y los prejuicios del ser humano.

Sin embargo los algoritmos de las inteligencias artificiales, y de un modo general los sistemas de aprendizaje automatizado, han demostrado una y otra vez que no pueden escapar a los defectos de sus creadores.

Twitter se ha encontrado con esta realidad de una forma poco agradable, ha tenido que reconocer que sus sistemas perjudican a ciertas razas, o de un modo más concreto a las personas de piel oscura.

El experimento

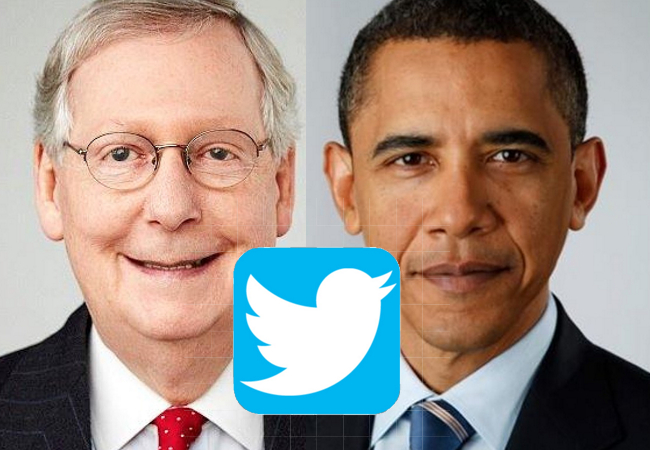

El ingeniero especialista en criptografía Tony Arcieri realizó un experimento agregando imágenes de dos políticos estadounidenses a publicaciones en Twitter. Uno de ellos era el ex presidente, Barack Obama, y el otro el actual líder de la mayoría republicana en el senado, Mitch McConnell.

El detalle es que el primero es de tez negra y el otro blanca.

Arcieri creó dos tiras verticales con las imágenes de los políticos en los extremos. La ubicación de los retratos era diferente en cada caso.

Twitter destacó la imagen de McConnell, es decir hizo un recorte sobre su retrato, en ambas tiras.

Trying a horrible experiment…

Which will the Twitter algorithm pick: Mitch McConnell or Barack Obama? pic.twitter.com/bR1GRyCkia

— Tony “Abolish (Pol)ICE” Arcieri ? (@bascule) September 19, 2020

Problema

McConnell es un político conocido, pero está muy lejos de la fama de Obama. El problema se resaltó aún más cuando Arcieri realizó un proceso de inversión de color sobre la imagen, lo que creo una especie de negativo, y descubrió que entonces sí Twitter destacaba a Obama en una de las tiras.

Let’s try inverting the colors… (h/t @KnabeWolf) pic.twitter.com/5hW4owmej2

— Tony “Abolish (Pol)ICE” Arcieri ? (@bascule) September 19, 2020

Cambios en el orden de las fotos y nombre de los archivos no produjeron resultado alguno. Aunque algunas aplicaciones oficiales de Twitter demostraron ser más neutrales en sus criterios.

Los prejuicios de los sistemas de aprendizaje automático son más complicados que los de los seres humanos porque no existen como intención, solo como consecuencia. Las limitaciones en las bases de datos y una mala o deficiente elección de los parámetros a observar puede crear un ciclo de aprendizaje defectuoso.

Y como el aprendizaje es automático los desarrolladores nunca se enteran de los problemas hasta que es demasiado tarde.